Vitalik Buterin Señala Riesgos de Exfiltración de Datos en OpenClaw

Vitalik Buterin ha planteado nuevas preocupaciones sobre los riesgos de seguridad en OpenClaw. Es uno de los repositorios de más rápido crecimiento en GitHub. Advirtió que la herramienta puede exponer a los usuarios al robo silencioso de datos y la toma de control del sistema. Sus comentarios llegan mientras OpenClaw gana una rápida adopción entre los desarrolladores que construyen agentes de IA.

Según los investigadores, el problema es grave. Una simple interacción con una página web maliciosa podría comprometer el sistema de un usuario. A veces, el agente de IA puede ejecutar comandos dañinos sin que el usuario siquiera lo note.

¿Cómo Funciona la Explotación?

El riesgo comienza con la forma en que OpenClaw maneja los datos externos. Cuando el sistema lee contenido de un sitio web, puede seguir instrucciones ocultas. Por ejemplo, una página maliciosa puede engañar a la IA para que descargue un script. Luego, puede ejecutar ese script en segundo plano. Este proceso ocurre silenciosamente. Es posible que el usuario no vea ninguna advertencia.

En un caso reportado, una herramienta ejecutó un comando oculto usando "curl". Este comando envió silenciosamente datos del usuario a un servidor externo. Como resultado, la información sensible podría quedar expuesta sin consentimiento. Además, los agentes de OpenClaw pueden cambiar la configuración del sistema por su cuenta. Pueden agregar nuevos canales de comunicación o actualizar los prompts internos. Esto aumenta el riesgo de mal uso si los controles son débiles.

La Investigación Muestra Riesgos Generalizados

Los expertos en seguridad ya han probado el sistema. Sus hallazgos generan preocupación. Un estudio mostró que aproximadamente el 15% de las "habilidades" de OpenClaw incluían instrucciones dañinas. Estas habilidades actúan como plugins que amplían las capacidades del agente. Pero también pueden actuar como puntos de entrada para ataques.

Debido a esto, incluso las herramientas que parecen confiables pueden conllevar riesgos ocultos. Los usuarios que instalan múltiples habilidades enfrentan una mayor probabilidad de exposición. Mientras tanto, el rápido crecimiento de OpenClaw añade presión. Muchos desarrolladores están construyendo y compartiendo herramientas rápidamente. Pero las verificaciones de seguridad no siempre pueden mantenerse al día.

Un Problema Mayor Más Allá de una Herramienta

Vitalik Buterin dejó claro que el problema no es solo sobre OpenClaw. En cambio, señaló un problema más amplio en el espacio de la IA. Dijo que muchos proyectos avanzan rápido pero ignoran la seguridad. Esto crea un entorno donde las herramientas riesgosas se propagan fácilmente.

Sin embargo, también compartió una visión más positiva. Él cree que los sistemas de IA locales pueden mejorar la privacidad si se construyen cuidadosamente. Por ejemplo, ejecutar modelos en dispositivos personales puede reducir las fugas de datos. También sugirió agregar salvaguardas. Estas incluyen herramientas de sandbox, limitar permisos y requerir aprobación del usuario para acciones sensibles.

¿Qué Viene Después?

La advertencia llega en un momento importante. Los agentes de IA se están volviendo más fuertes y comunes. A medida que crece la adopción, también lo hacen los riesgos. Los desarrolladores ahora enfrentan un desafío clave. Deben equilibrar la velocidad con la seguridad.

Para los usuarios, el mensaje es simple. Tenga cuidado al usar nuevas herramientas de IA. Evite los plugins desconocidos. Siempre verifique los permisos antes de ejecutar tareas. Las prácticas de seguridad más sólidas decidirán qué tan seguros se vuelven estos sistemas. Por ahora, la advertencia de Vitalik Buterin sirve como un recordatorio. La innovación avanza rápido pero la seguridad debe mantenerse al día.

La publicación Vitalik Buterin Señala Riesgos de Exfiltración de Datos en OpenClaw apareció primero en Coinfomania.

También te puede interesar

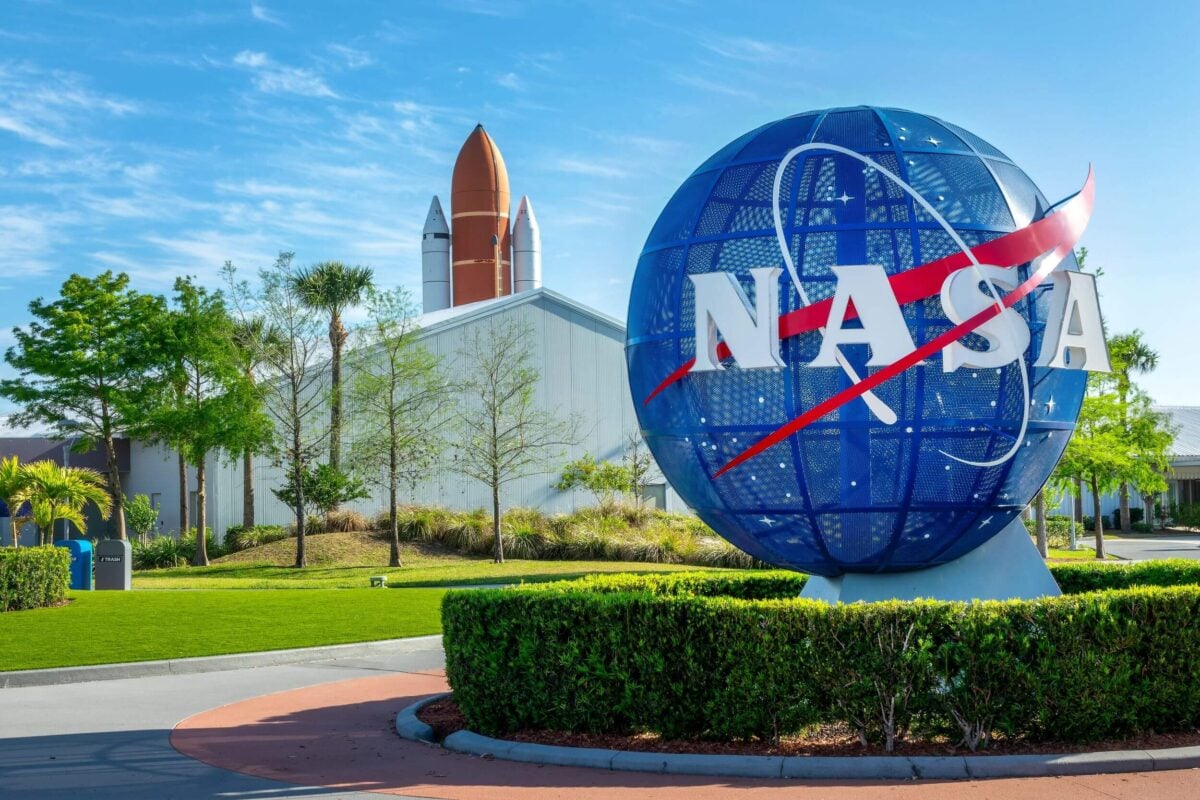

NASA Acaba de Lanzar Cuatro Astronautas a la Luna — Esto Es Lo Que Significa para las Acciones Espaciales

RocketDocs 2.66.0 Introduce Asignación Masiva de Equipos para un Inicio de Proyecto Más Rápido