OpenAI یک طرح سیاست منتشر کرده است که اقدامات امنیتی جدیدی را که صنعت هوش مصنوعی (AI) میتواند برای جلوگیری از استفاده از این فناوری برای تولید مواد سوء استفاده جنسی از کودکان انجام دهد، ترسیم میکند.

OpenAI در اعلامیه 1403/01/19 خود گفت: "سوء استفاده جنسی از کودکان یکی از فوریترین چالشهای عصر دیجیتال است." "هوش مصنوعی به سرعت در حال تغییر است که چگونه این آسیبها در سراسر صنعت ظاهر میشوند و چگونه میتوان آنها را در مقیاس وسیع مدیریت کرد."

با در نظر گرفتن این موضوع، شرکت طرح سیاست خود را فاش کرد و "مسیر عملی رو به جلو برای تقویت چارچوبهای حمایت از کودکان ایالات متحده در عصر هوش مصنوعی" را ترسیم کرد.

به گفته این غول هوش مصنوعی، این طرح بازخورد چندین سازمان پیشرو و کارشناسان در اکوسیستم امنیت کودکان، از جمله مرکز ملی کودکان گمشده و مورد سوء استفاده (NCMEC)، اتحاد دادستان کل - یک گروه غیرانتفاعی از دادستانهای کل ایالتی در ایالات متحده - و Thorn، یک سازمان غیرانتفاعی اختصاص یافته به دفاع از کودکان در برابر سوء استفاده جنسی، را منعکس و ادغام میکند.

OpenAI گفت: "هیچ مداخله واحدی نمیتواند به تنهایی به این چالش رسیدگی کند." "این چارچوب رویکردهای قانونی، عملیاتی و فنی را گردهم میآورد تا ریسکها را بهتر شناسایی کند، پاسخها را تسریع کند و از پاسخگویی حمایت کند، در حالی که اطمینان میدهد مقامات اجرایی با تکامل فناوری قوی باقی میمانند."

این اقدام در حالی صورت میگیرد که نگرانیها به طور فزایندهای پیرامون سوء استفاده از ابزارهای هوش مصنوعی، به ویژه عملکردهای تولید تصویر، برای تولید تصاویر صریح از زنان و کودکان، از جمله افراد مشهور و شخصیتهای عمومی، افزایش یافته است.

در اوایل ژانویه، ناظر ارتباطات بریتانیا، Ofcom، مجبور شد با X و xAI تماس فوری برقرار کند "تا متوجه شود چه اقداماتی برای رعایت وظایف قانونی خود برای محافظت از کاربران در بریتانیا انجام دادهاند"، پس از آنکه گزارشهایی مبنی بر استفاده از چتبات هوش مصنوعی Grok ایلان ماسک برای ایجاد و انتشار تصاویر صریح از کودکان و زنان با لباسهای به صورت دیجیتالی حذف شده منتشر شد.

نگرانیهای مشابهی در اتحادیه اروپا مطرح شد، به طوری که مقام حفاظت از دادههای ایتالیا کاربران و ارائهدهندگان ابزارهای هوش مصنوعی را نسبت به خطرات "حقوق و آزادیهای اساسی" ناشی از دیپ فیکهای هوش مصنوعی هشدار داد.

برای رسیدگی به چنین نگرانیهایی، OpenAI گفت که سه اولویت کلیدی دارد: نوسازی قوانین برای مبارزه با مواد سوء استفاده جنسی از کودکان تولید شده و تغییر یافته توسط هوش مصنوعی، بهبود گزارشدهی و هماهنگی ارائهدهنده برای پشتیبانی از تحقیقات مؤثرتر، و ایجاد اقدامات امنیتی طراحی شده مستقیماً در سیستمهای هوش مصنوعی برای جلوگیری و شناسایی سوء استفاده.

شرکت در بیانیه 1403/01/19 خود گفت: "با هم، این اقدامات صنعت را قادر میسازد تا زودتر و مؤثرتر به امنیت کودکان رسیدگی کند." "با قطع تلاشهای سوء استفاده زودتر، بهبود کیفیت سیگنالهای ارسال شده به مجریان قانون، و تقویت پاسخگویی در سراسر اکوسیستم، این چارچوب با هدف جلوگیری از آسیب قبل از وقوع و کمک به اطمینان از حفاظت سریعتر برای کودکان هنگام بروز خطرات است."

OpenAI گفت که همچنین متعهد به ادامه تقویت پادمانها برای جلوگیری از سوء استفاده از سیستمهای خود است، و همچنین به همکاری نزدیک با شرکایی مانند NCMEC و مجریان قانون برای بهبود شناسایی و گزارشدهی.

در یک بیانیه مشترک در مورد طرح امنیت کودکان، دادستانهای کل ایالت جف جکسون (کارولینای شمالی) و درک براون (یوتا)، رؤسای مشترک کارگروه هوش مصنوعی اتحاد دادستان کل، گفتند که "از این طرح به عنوان یک گام معنادار به سوی هماهنگ کردن شیوههای امنیت کودکان بخش فناوری با واقعیتهای اجرایی که دفاتر ما هر روز با آن مواجه هستند، استقبال میکنیم."

این دو به ویژه به شناخت چارچوب اشاره کردند که پادمانهای مؤثر هوش مصنوعی مولد (GenAI) نیاز به دفاعهای لایهای دارند - نه یک کنترل فنی واحد، بلکه ترکیبی از شناسایی، مکانیسمهای امتناع، نظارت انسانی و سازگاری مستمر با روندهای سوء استفاده نوظهور.

دادستانهای کل ایالت گفتند: "این منعکس کننده آنچه در عمل میبینیم است: تهدید به طور مداوم تکامل مییابد و راه حلهای ایستا ناکافی هستند."

از اعلامیه OpenAI توسط میشل دلان، رئیس و مدیر اجرایی NCMEC نیز استقبال شد، که هشدار داد که هوش مصنوعی مولد "در حال تسریع جرم سوء استفاده جنسی آنلاین از کودکان به روشهای عمیقاً نگرانکننده است - کاهش موانع، افزایش مقیاس و امکان اشکال جدید آسیب."

دلان افزود که "از دیدن شرکتهایی مانند OpenAI که بر نحوه طراحی مسئولانهتر این ابزارها، با پادمانهای ساخته شده از ابتدا، تأمل میکنند، تشویق میشود."

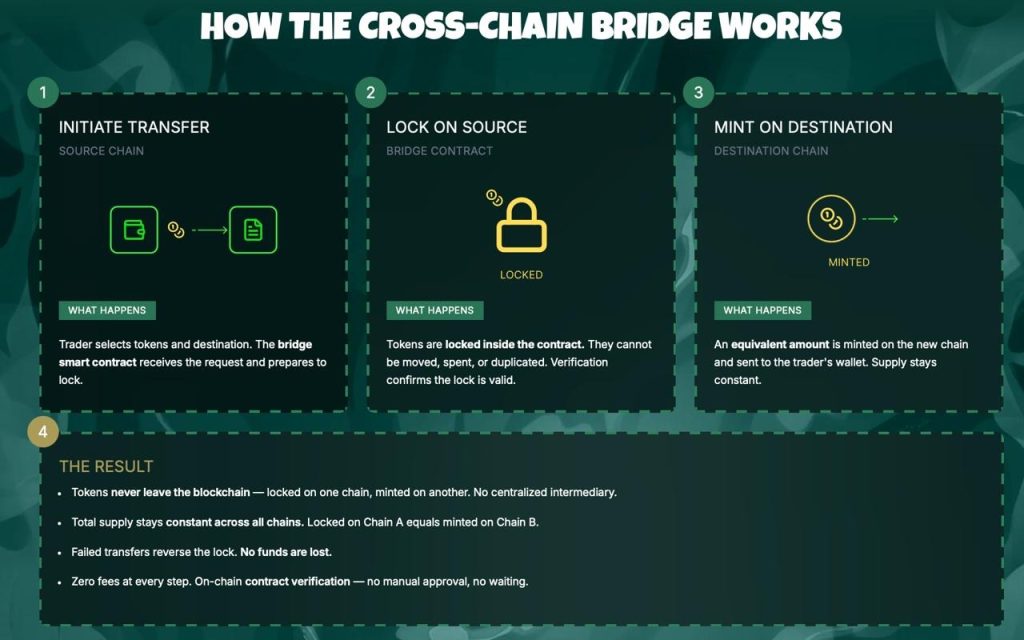

برای اینکه هوش مصنوعی (AI) در چارچوب قانون به درستی کار کند و در مواجهه با چالشهای رو به رشد پیشرفت کند، نیاز به یکپارچهسازی یک سیستم بلاک چین سازمانی دارد که کیفیت ورودی داده و مالکیت را تضمین کند - و به آن اجازه میدهد دادهها را ایمن نگه دارد و در عین حال تغییرناپذیری دادهها را تضمین کند. پوشش CoinGeek را در مورد این فناوری نوظهور بررسی کنید تا بیشتر بدانید چرا بلاک چین سازمانی ستون فقرات هوش مصنوعی خواهد بود.

تماشا کنید: نشان دادن پتانسیل ترکیب بلاک چین با هوش مصنوعی

منبع: https://coingeek.com/openai-blueprint-targets-ai-enabled-child-exploitation/