Subnetul 3 al Bittensor antrenează un model AI de 72B pe o rețea descentralizată

TLDR:

- Covenant-72B a obținut scorul 67,1 la MMLU zero-shot, depășind LLaMA-2-70B cu 65,6 în condiții de testare identice.

- SparseLoCo a redus overhead-ul de comunicare de 146 de ori utilizând sparsificarea, cuantizarea pe 2 biți și feedback-ul de eroare între noduri.

- Gauntlet a evaluat contribuția fiecărui nod prin evaluarea pierderilor și clasamentul OpenSkill, toate înregistrate pe blockchain.

- $TAO a crescut cu 14% la $236 după anunț, Grayscale extinzându-și trust-ul TAO pentru acces investitorilor instituționali.

Subnet 3 al Bittensor a antrenat un model AI cu 72 de miliarde de parametri fără un centru de date central. Modelul, numit Covenant-72B, a fost construit cu participarea a peste 70 de participanți globali.

Toate nodurile sunt conectate prin internet standard de acasă. Covenant-72B a depășit LLaMA-2-70B de la Meta pe benchmark-ul MMLU, obținând scorul 67,1 față de 65,6.

Testul a fost efectuat în condiții zero-shot identice. Acest rezultat contestă presupunerile de lungă durată despre ceea ce poate realiza computing-ul descentralizat.

Două inovații tehnice au condus antrenamentul descentralizat

Ani de zile, proiectele crypto AI au susținut că computing-ul descentralizat ar putea egala laboratoarele centralizate. Subnet 3 al Bittensor susține acum această afirmație cu rezultate măsurabile.

Antrenamentul a acoperit 1,1 trilioane de token-uri pe peste 70 de noduri la nivel mondial. Fiecare nod a funcționat pe conexiuni internet comerciale de 500 Mb/s.

Două inovații centrale au făcut posibilă această scară de antrenament. SparseLoCo a redus overhead-ul de comunicare de 146 de ori pe parcursul procesului.

A combinat sparsificarea top-k, cuantizarea pe 2 biți și feedback-ul de eroare pentru a menține toate nodurile sincronizate. Nu a fost nevoie de un server central pentru a gestiona coordonarea în rețea.

A doua inovație, Gauntlet, a gestionat încrederea și evaluarea contribuțiilor în timpul antrenamentului. A evaluat fiecare nod prin evaluarea pierderilor și clasamentul OpenSkill.

Toate scorurile au fost înregistrate pe blockchain pentru transparență totală. Acest lucru a oferit fiecărui participant o înregistrare verificabilă a contribuției sale.

Milk Road a raportat despre rezultat prin intermediul rețelelor sociale, menționând că rețelele distribuite pot acum antrena modele mari competitiv. Ponderile modelului sunt disponibile pe Hugging Face sub licență Apache.

Oricine poate accesa, utiliza sau construi pe Covenant-72B fără costuri. Această abordare deschisă îl diferențiază de multe modele AI restricționate și proprietare disponibile astăzi.

$TAO crește pe măsură ce piața răspunde la rezultatele Covenant-72B

Piața s-a mișcat rapid după ce vestea despre antrenamentul Covenant-72B s-a răspândit public. $TAO, token-ul nativ al Bittensor, a crescut cu 14% ajungând la $236 după anunț.

Token-ul câștigase, de asemenea, 36% în perioada anterioară de 30 de zile. Volumul de tranzacționare a crescut cu 167% în ultimele șase luni.

Grayscale și-a extins trust-ul TAO în aceeași săptămână cu anunțul. Această mișcare a deschis un acces instituțional mai larg la token în mod direct.

A venit în contextul în care interesul investitorilor pentru activele crypto legate de AI a continuat să crească. Momentul a adăugat presiune ascendentă suplimentară asupra mișcării prețului token-ului.

Combinația dintre rezultatul tehnic și interesul instituțional a atras atenția largă a pieței. Scorul MMLU al Covenant-72B oferă computing-ului descentralizat un benchmark credibil și testabil.

Rezultatul este măsurabil și poate fi reprodus în condiții standard. Acest lucru îl distinge clar de multe afirmații anterioare neverificate din spațiul crypto AI.

Ponderile cu licență Apache de pe Hugging Face permit oricărui dezvoltator să verifice lucrarea în mod independent. Abordarea Bittensor demonstrează un cadru funcțional pentru antrenamentul de modele AI condus de comunitate.

Rețeaua a funcționat cu peste 70 de participanți fără coordonare centrală în niciun moment. Acest lucru stabilește un precedent funcțional pentru antrenamentul distribuit de modele mari în viitor.

Articolul Bittensor's Subnet 3 Trains 72B AI Model on Decentralized Network a apărut pentru prima dată pe Blockonomi.

Poate îți place și

Activiști pro-arme distribuie încărcătoare AR-15 la Capitoliu pentru a sfida viitoarea interdicție

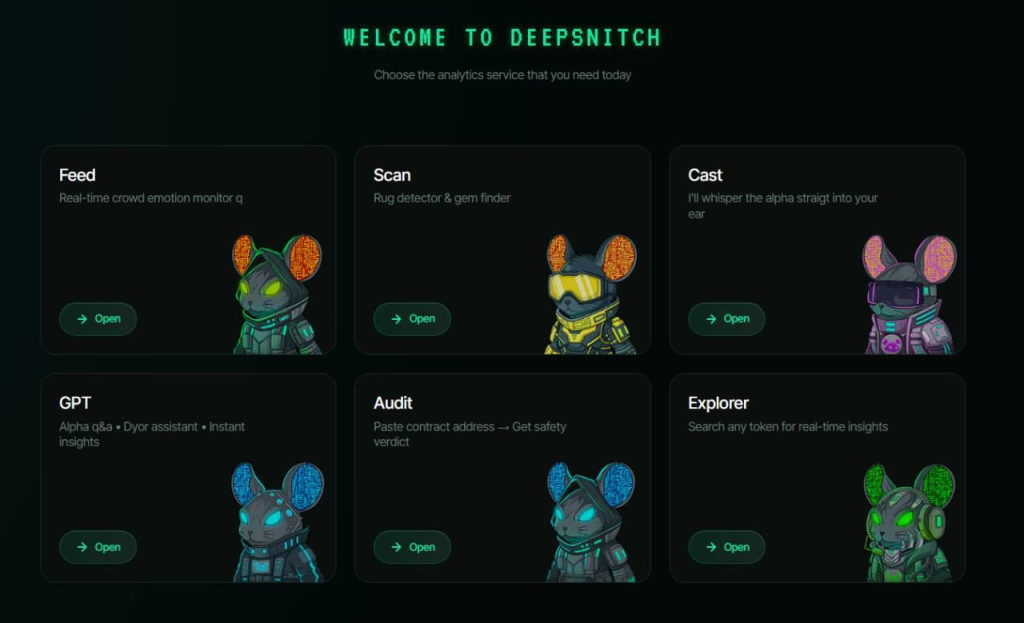

DeepSnitch AI Data Lansare 2026: Ethereum Impune Piloni Fundamentali În Timp Ce Bitcoin și NEAR Se Prăbușesc În Fața Unei Ancora de Salvare DSNT 100x